1. Hold-out

Hold-out 방법은 데이터를 train, test set으로 나누고 train set에서 학습된 모델을 test set에서 성능을 평가하는 방식이다(held-out method라고도 함)

2. Cross-validation

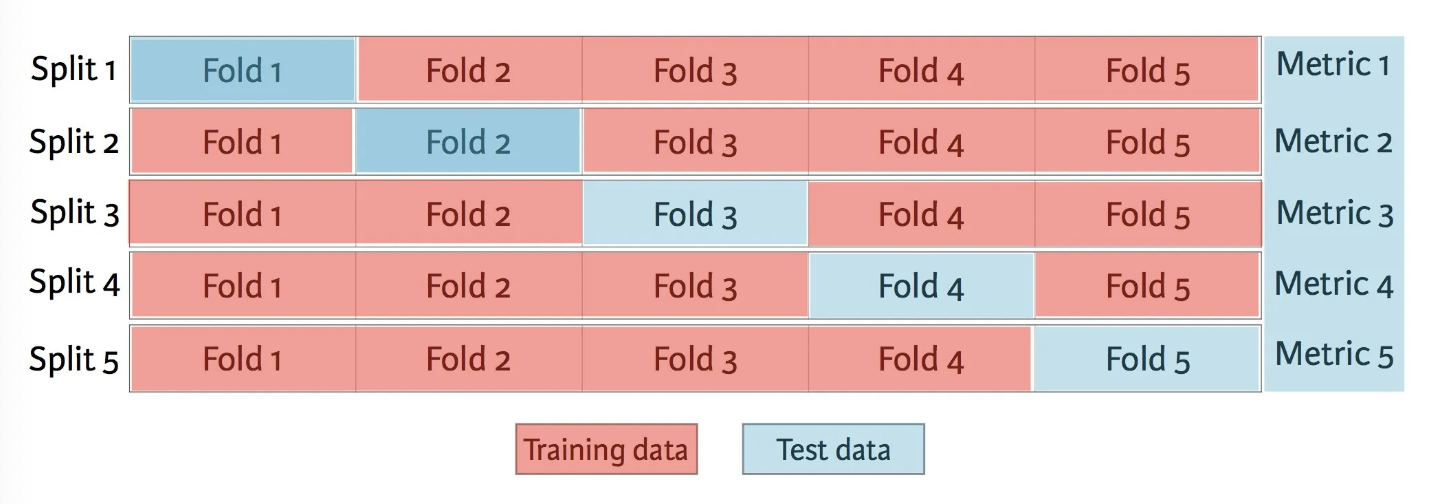

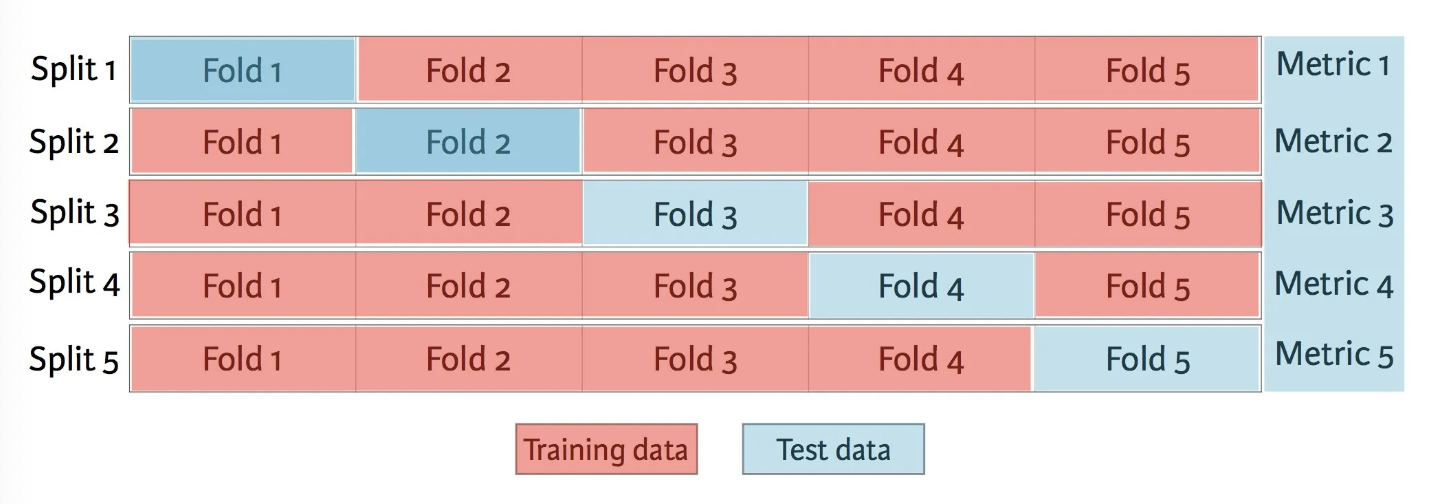

Cross-validation은 k-fold cross validation이라고도 하며, hold-out 방법을 k번 시행하되 매번 새로운 train/test set으로 진행하는 방식이다. 아래 그림에서 처럼 모든 데이터셋이 test set으로 사용될 때 까지 돌린다.

* Hold-out vs Cross-validation

Hold-out은 데이터셋이 매우 크고 시간이 없거나 PoC 컨셉으로 모델을 테스트해볼 때 유용하다. Cross-validation은 시간과 학습비용이 크기 때문에 잘 사용되지는 않는다.

[출처]

'논문 및 개념 정리' 카테고리의 다른 글

| Vector Outer Product (0) | 2024.06.26 |

|---|---|

| [2023] The Wisdom of Hindsight Makes Language Models Better Instruction Followers (1) | 2023.12.01 |

| Propensity Score (0) | 2023.06.28 |

| [2021] (FLAN)FINETUNED LANGUAGE MODELS ARE ZERO-SHOT LEARNERS (Instruction-Tuning 논문) (2) | 2023.03.13 |

| [2015] Deep Residual Learning for Image Recognition (ResNet 논문) (0) | 2023.01.14 |

1. Hold-out

Hold-out 방법은 데이터를 train, test set으로 나누고 train set에서 학습된 모델을 test set에서 성능을 평가하는 방식이다(held-out method라고도 함)

2. Cross-validation

Cross-validation은 k-fold cross validation이라고도 하며, hold-out 방법을 k번 시행하되 매번 새로운 train/test set으로 진행하는 방식이다. 아래 그림에서 처럼 모든 데이터셋이 test set으로 사용될 때 까지 돌린다.

* Hold-out vs Cross-validation

Hold-out은 데이터셋이 매우 크고 시간이 없거나 PoC 컨셉으로 모델을 테스트해볼 때 유용하다. Cross-validation은 시간과 학습비용이 크기 때문에 잘 사용되지는 않는다.

[출처]

'논문 및 개념 정리' 카테고리의 다른 글

| Vector Outer Product (0) | 2024.06.26 |

|---|---|

| [2023] The Wisdom of Hindsight Makes Language Models Better Instruction Followers (1) | 2023.12.01 |

| Propensity Score (0) | 2023.06.28 |

| [2021] (FLAN)FINETUNED LANGUAGE MODELS ARE ZERO-SHOT LEARNERS (Instruction-Tuning 논문) (2) | 2023.03.13 |

| [2015] Deep Residual Learning for Image Recognition (ResNet 논문) (0) | 2023.01.14 |